Memoria Sináptica

Memoria Sináptica – Instalación inmersiva de Nuevos Medios

Proyecto Financiado por el Fondo Nacional de Desarrollo Cultural y las Artes,

Convocatoria 2020. Folio: 564428

Proyecto Realizado por Cristian Galarce López

Registro en vivo realizado con el apoyo de CIAUV que muestra una versión actual del proyecto.

Abstract

‘Memoria Sináptica’ es un proyecto de creación y producción de una instalación inmersiva, propia del ámbito de los Nuevos Medios, que se ubica en una intersección entre el Arte Interactivo, el Arte Sonoro y las Artes Mediales, y se plantea en una relación con el conocimiento científico a partir de un uso reflexivo y estético de las nuevas tecnologías, con intensión crítica y experimental. Partiendo de una idea germinal, borradores y maquetas, se busca desarrollar un proceso creativo más profundo, que involucra una conceptualización detallada en términos teóricos y también prácticos.

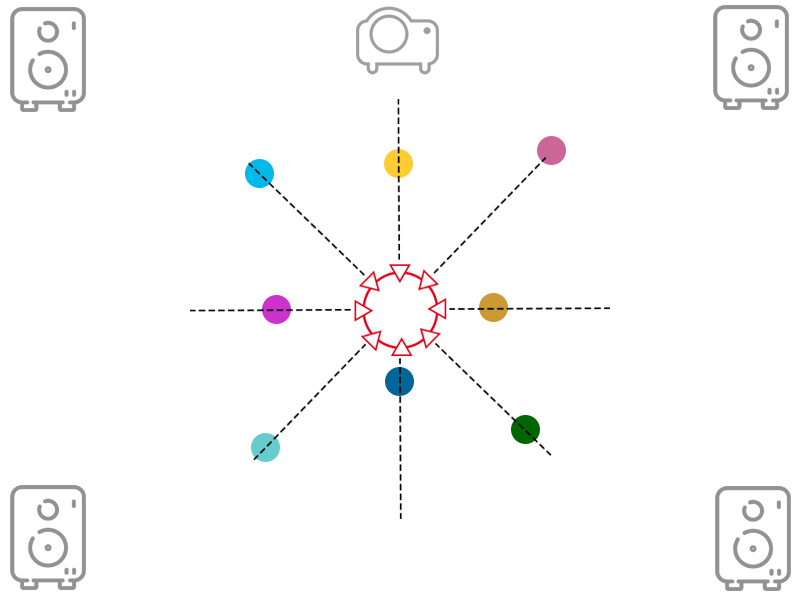

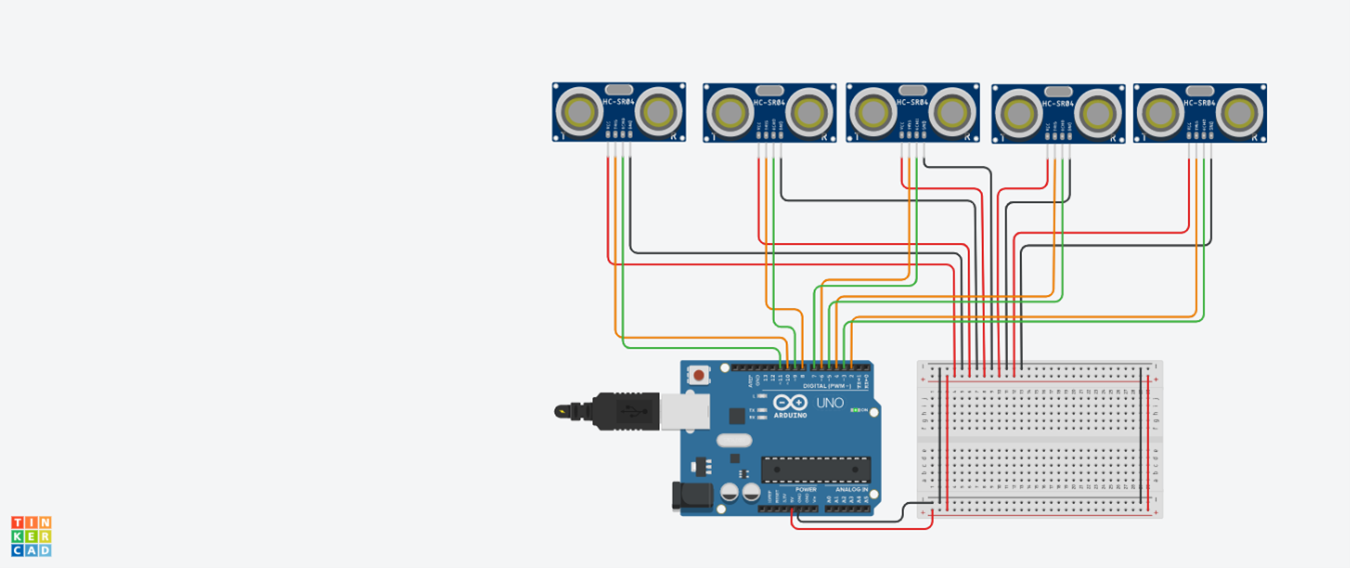

fig 1 Esquema inicial

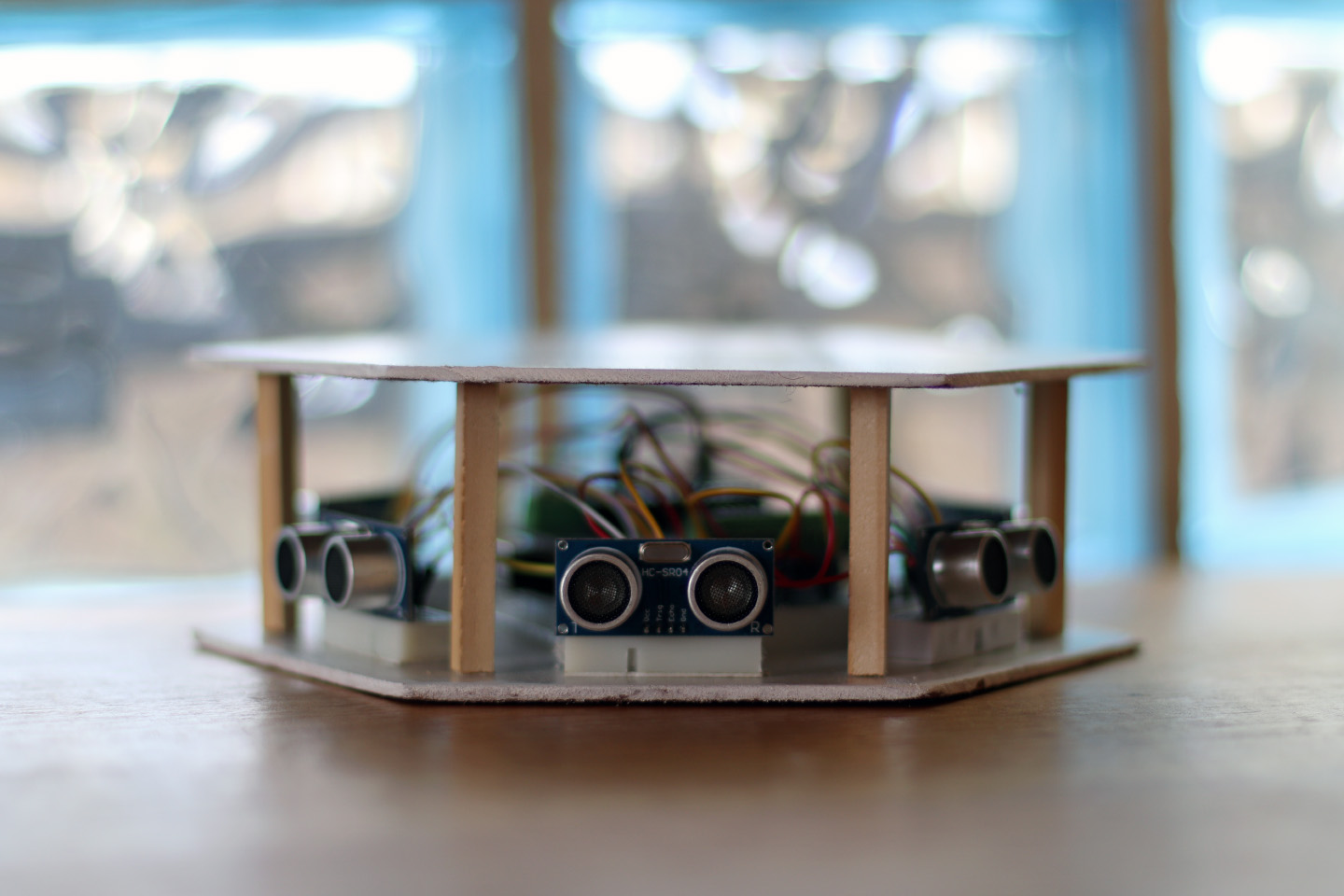

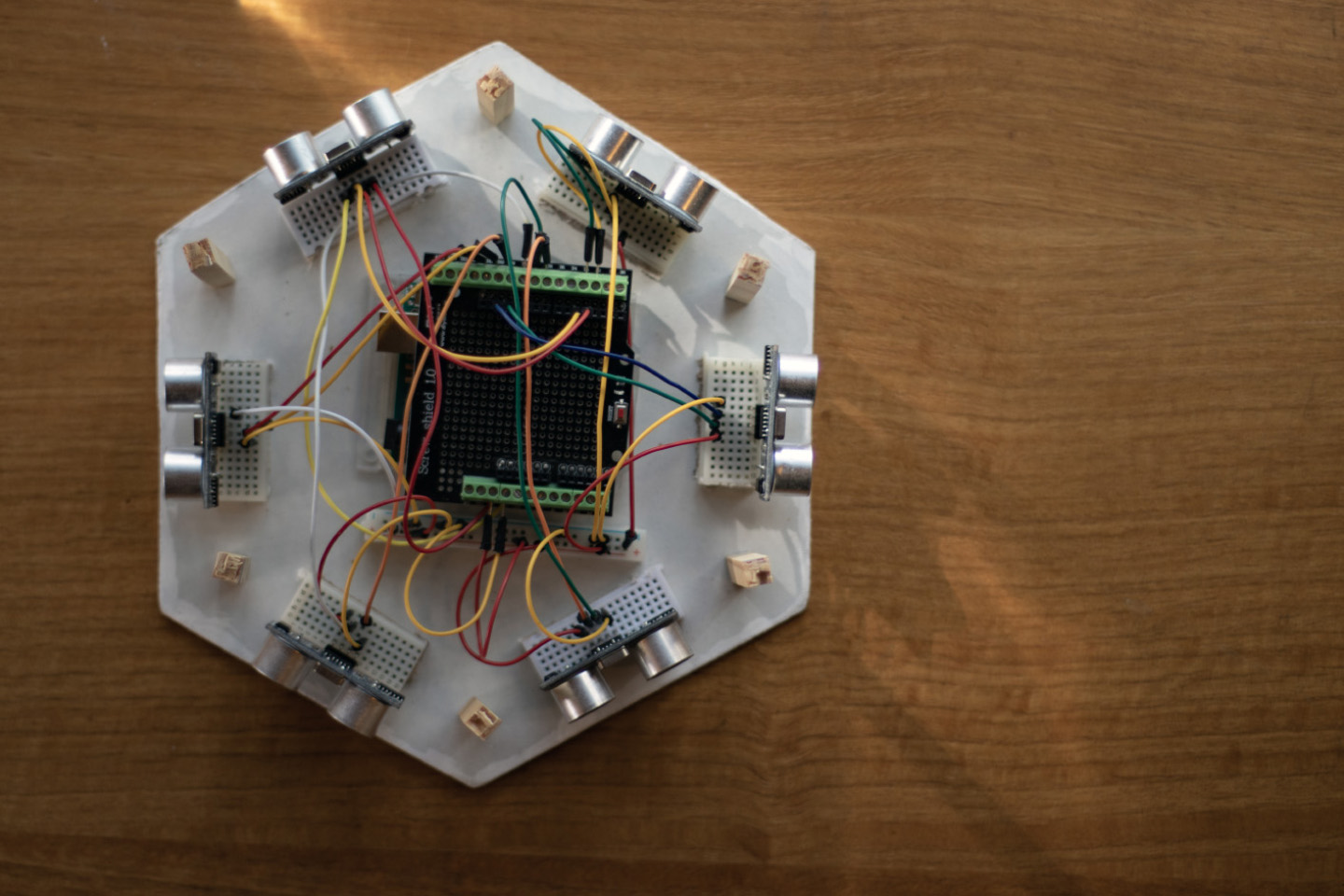

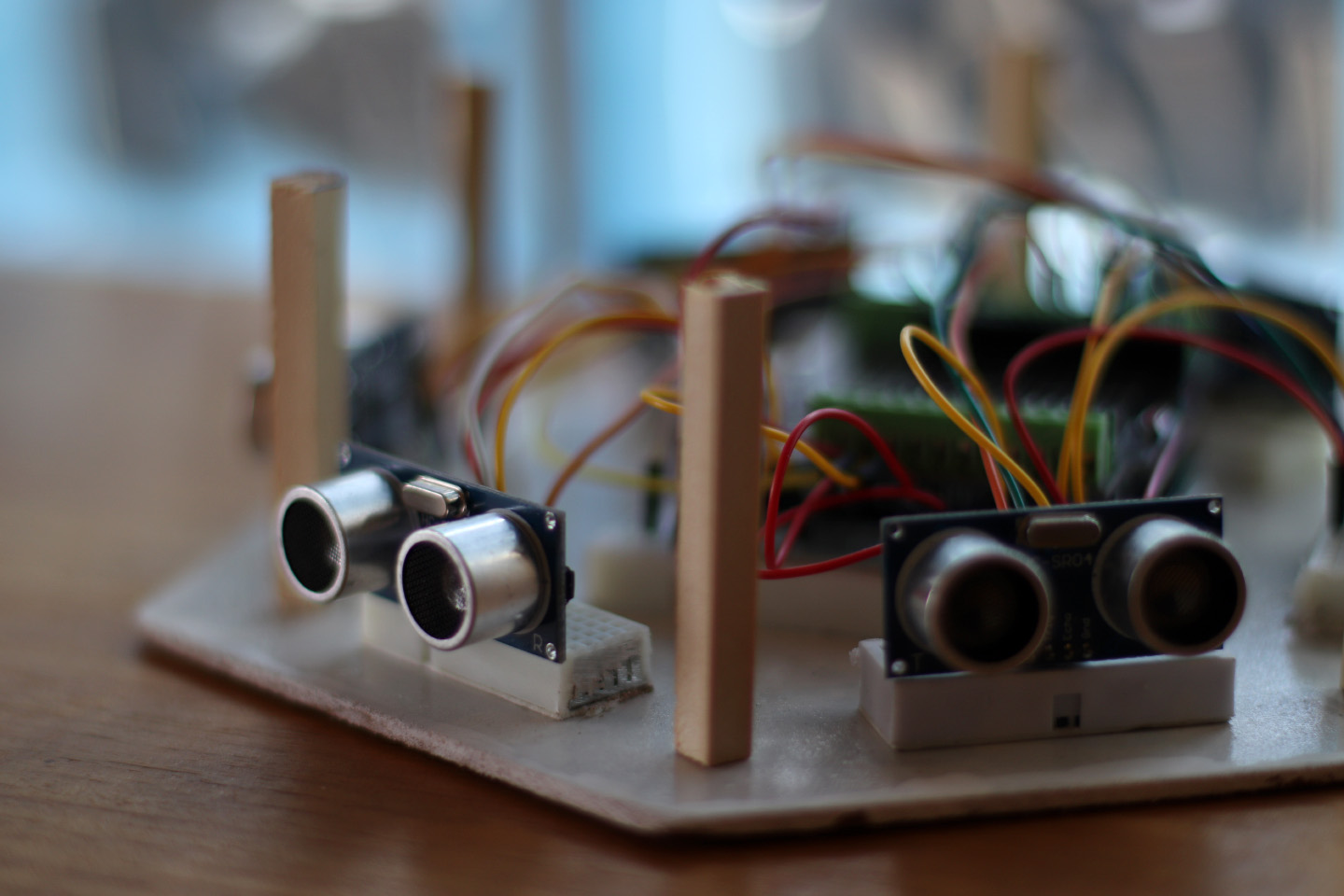

El objeto físico central de ‘Memoria Sináptica’ es un sensor de proximidad de 6 canales, con forma de hexágono, de ancho aproximado de 20 cm, lados de 10 cm y 5,5 cm de alto, cuyo centro es una placas Arduino Wi-Fi Rev2. Este objeto opera como radar, es decir, detecta y ubica en el espacio los objetos dispuestos a su alrededor, a través de 6 Sensores de proximidad HC-SR04. El artefacto está pensado para ser ubicado al centro de una mesa de altura común -idealmente circular, puesta al centro de una sala, desde donde se comunica con un ordenador. A su alrededor se disponen 6 objetos físicos a ser manipulados por el visitante, siendo la función de estos objetos intervenir en la medición de proximidad de cada uno de los sensores, interactuando de este modo el visitante con la instalación (objetos representados por circunferencias de colores en figura 1).

Este flujo de datos de proximidad es recibido y procesado en tiempo real en el ordenador mediante Max/Msp, donde se realizan diversos tipos de síntesis de audio -aditiva, sustractiva, en anillo, granular, etc.-, y se gatillan otro tipo de eventos sonoros. Luego, ya como audio, se reenvía la señal por 4 canales hacia las 4 esquinas de la sala. Por otra parte, los mismos datos de los sensores de proximidad, sumados a la data raw de audio, son utilizados para realizar procesos sobre colores, formas e imágenes sintéticas y pregrabadas, y reenviados como imagen hacia la escena.

Tanto el sonido como la imagen resultan depender entonces del modo o los modos en que el mismo visitante mueva los objetos sobre la mesa, actuando en tiempo real sobre el resultado audiovisual en el que está inmerso.

Se trata, en este proyecto, de poner en movimiento la habilidad cognitiva de la memoria experiencial, a través de la inmersión del visitante en una situación de aprendizaje sensorial que le resulta inédita (también inaudita, podríamos decir), y sobre la cual puede realizar actuaciones e intervenir.

La simplicidad del esquema físico base de la instalación propuesta (6 objetos movibles en torno a un centro) habilita la posibilidad de crear rápidamente memorias perceptivas, lo que permite al visitante, por ejemplo, ya avanzada su exploración del artefacto, volver atrás a cierta configuración ya vivenciada, ya aprendida minutos atrás, moverse entre diversos modos, apelando a su experiencia previa sonora, visual, corporal. Se trata, entonces, de poner en juego la habilidad cognitiva de la memoria en términos sensoriales, cimentándola en cierta memoria física que ofrece el propio artefacto-sistema, que responde efectivamente a la cognición activa y la exploración sensorial del visitante. Memoria Sináptica pone en movimiento, en el fondo, cierta memoria háptica, en un sentido ampliado, como memoria táctil que involucra también la manipulación activa de objetos y la propiocepción, como un todo, como unidad somatosensorial ([1]).

No se trata, por tanto, de un ejercicio de simulación de la actividad sináptica, o de un intento de ilustración de una teoría científica, visualización de datos, ni siquiera de una analogía, en estricto rigor. Se trata, más bien, de un ejercicio puramente estético que se relaciona con su tema (memoria, sinapsis, plasticidad) de manera metafórica, y que intenta poner en juego ciertos elementos perceptuales de modo enactivo, diremos, en términos de la teoría de la embodied cognition, en la línea teórica de Francisco Varela y otros autores ([2]). Se trata, entonces, de la percepción como acción ejecutada, y de la cognición como una actividad que se da necesariamente en la relación entre un cuerpo y su entorno, como un fenómeno activo de naturaleza bidireccional, donde conocer y percibir es indisolublemente un modo de actuar.

Referencias visuales

Referentes visuales para elaborar el trabajo de generación y procesamiento de imágenes.

Estructura macromolecular de la proteína CaMKII, vista 3D.

Tomado de: Chao, L.H., Kuriyan, J. (2011) “A Mechanism for Tunable Autoinhibition in the Structure of a Human Ca2+/Calmodulin- Dependent Kinase II Holoenzyme” en Cell Journal 146, issue 5, p.732-745. CellPress. DOI= https://doi.org/10.1016/j.cell.2011.07.038

Modelo de la proteína CaMKII y su ‘complejo de unión’ (binding complex)

Tomado de: Wang, Qian; Chen, Mingchen et al. (2019) “Assemblies of calcium/calmodulin-dependent kinase II with actin and their dynamic regulation by calmodulin in dendritic spines” en: Proceedings of the National Academy of Sciences 116 (38) 18937-18942; DOI: https://doi.org/10.1073/pnas.1911452116

Procesos microgliales neurales y botones sinápticos

Tomado de: Weinhard, L., di Bartolomei, G., Bolasco, G. et al. (2018) “Microglia remodel synapses by presynaptic trogocytosis and spine head filopodia induction”. En: Nat Commun 9, 1228 (2018). https://doi.org/10.1038/s41467-018-03566-5

Especificaciones:

Tabla de Componentes:

Placa Arduino Uno Wi-Fi Rev2; Screwshield para Arduino Uno; Cables y resistencias, Leds, Cables USB, accesorios; 6 Sensores de proximidad HC-SR04; Protoboard; Tarjeta de sonido 4x4 USB 3.0

Software: Arduino IDE y Max/Msp

Código de programación (Sketch) de Arduino: [link descarga]

Patches de Max/Msp: [link descarga]

Diseño y Especificaciones técnicas:

Esquema lógico de conexiones

[1] Delhaye, B.P., Long, K.H. and Bensmaia, S.J. (2020). “Neural Basis of Touch and Proprioception in Primate Cortex”. In Comprehensive Physiology, D.M. Pollock (Ed.). DOI= https://doi.org/10.1002/cphy.c170033

[2] De Jaegher, Hanne; Rohde, Marieke (2010) Enaction: Toward a New Paradigm for Cognitive Science. Mit Press. London.